박소영

박소영

[The Psychology Times=박소영 ]

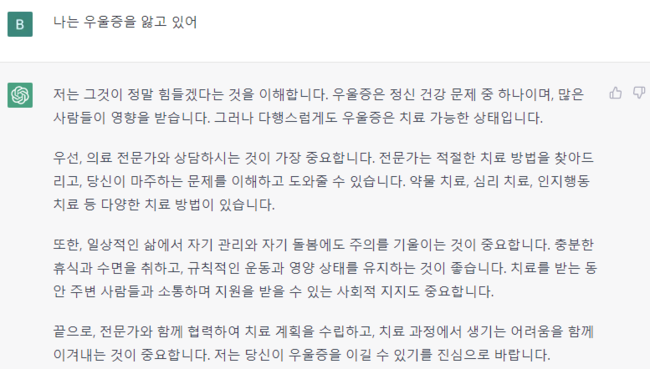

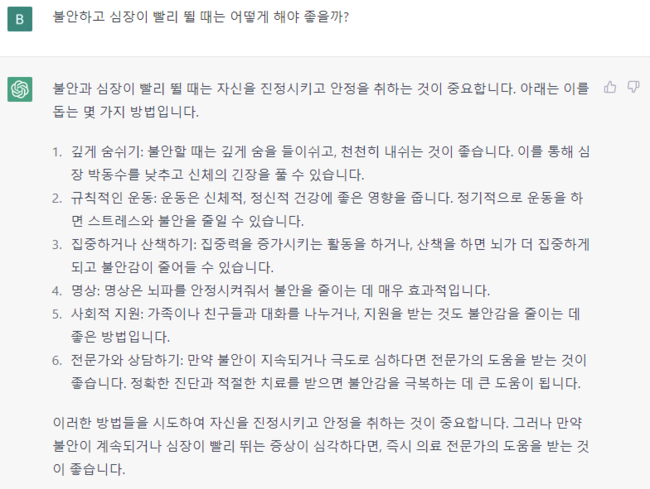

위에 보이는 대화 내용은 대화형 인공지능, 챗지피티(Chat GPT)와 나눈 대화로, 1분에서 2분이 안 되는 시간 동안 AI가 우울증과 불안장애에 관한 기술을 설명하는 것을 보여준다.

챗지피티는 Open AI에서 처음 개시되면서부터 어마어마한 양의 데이터로 사람들을 놀라게 했다. 이전과는 차원이 다른 정보 수집과 창의성을 보여주기 시작하면서 많은 학자들이 그 가능성을 의문하고 있는 가운데, 미래 심리 상담사들이 주목할만한 부분은 AI가 과연 사람들에게 심리 상담을 제공해 줄 수 있을까이다. 실제로, 최근에 미국에서는 코코 봇(Koko bot)이라는 AI 심리상담 매체가 주목받았는데 정신 건강 문제를 겪고 있는 개인을 도와주기 위해 GPT의 제시 답변을 이용자끼리 주고받는 시스템이다. AI와 심리 상담에 관한 대표적인 예시 중 하나이지만, 창립자인 로버트 모리스 또한 "인공지능을 통해 공감 능력을 쌓는 건 힘든 일"이라고 인정하였듯 챗지피티를 정신 상담에 사용할 경우 발생할 수 있는 윤리적인 문제에 많은 이들이 우려를 표하고 비판을 하였다.

Chat GPT란 무엇인가?

간략히 설명하자면, 챗지피티에서 지피티(GPT)는 Generative Pretrained Transformer의 약자로, 인공지능이 인터넷의 정보와 데이터를 사용해 자율적으로 정보를 생산해내는 능력을 가르킨다. 챗지피티(Chat GPT)에서 챗은 '채팅(Chatting)'의 줄임말로 대화를 가르키며, 둘이 합쳐 언어 기술을 활용한 대화 전문 인공지능 챗봇이라고 알려져 있다. 따라서 챗지피티는 인터넷과 데이터에 존재하는 사람의 언어와 표현 방식을 모방하여 이용자의 프롬프트(지시어)에 따라 사실적인 답변을 제공해준다.

심리상담의 핵심

실로, 위에서 언급된 코코 봇과 같이 엄청난 정보량을 중심으로 작동하는 챗지피티는 피상적인 정보를 제공해 줄 수는 있지만 심리 상담 자체를 실행할 수 있을지는 아직 의문이다. 본디, 심리 상담은 심리상담 자격증을 보유하고 있는 전문가와 이루어지며, 대부분 30분에서 45분 가량의 대화를 통해 내담자 스스로에 대한 이해를 도와준다. 더 나아가, 상담사는 내담자들의 정신적 그리고 육체적 건강을 찾을 있도록 지도하며 독립성을 심어준다. 이 모든 것을 이루기 위해, 상담사는 상담하는 시간 동안 내담자의 이야기를 들으며 실존주의적 질문을 통해 분열된 자아를 이어주고 삶의 어느 갈림길에 서 있는지, 그다음 방향을 어디로 잡을지 선택하도록 도와주는 역할을 한다.

Chat GPT와 심리상담: 과연 가능할까?

위의 설명에서 암시되었듯 심리 상담이라는 직업은 엄청난 공감 능력과 사회적 그리고 맥락의 이해를 필요로 하는 직업이다. 최근 지피티와 챗지피티에 관한 수업을 듣는 중, 교수님께서 이러한 이야기를 하셨다. "더 이상 AI가 존재하는지에 대한 유무의 질문이 아니라, 어떻게 하면 인간이 AI와 통합되어 살아갈 수 있을지"라고 말이다. 더 나아가, AI가 어떻게 의료 시스템에 적용될지 설명하는 논문에 의하면, 소위 말해 더 이상 AI가 어떻게 의사를 대체할지에 관한 문제가 아니라 AI를 사용하는 의사와 AI를 사용하지 않는 의사에 관한 논쟁이라 말한다.

개인적으로 생각하는 AI와 인간의 큰 차이점은 감정의 깊이를 이해하는 것과, 특히, 심리 상담사가 내담자를 볼 때 이해하는 한 사람의 완전체, 또는 개인과 사회가 가지는 관계와 같은 이해이다. 만일 AI가 심리 상담 분야를 장악한다 해도 그 여파는 분명 엄청날 것이다. 수많은 사람이 살아온 삶들과 그 경험의 뉘앙스를 이해하기엔 AI가 장담하는 학술자료, 데이터, 그리고 정보만 가지고 익힐 수 있는 분야가 아니기 때문이다. 더군다나, AI가 정신 장애를 진단하게 된다면 피상적인 정보만 가지고 DSM과 같은 진단 매뉴얼을 남용하게 되어 내담자에게 큰 피해를 끼칠 수도 있다.

사람의 인격, 감정, 도덕성은 AI의 힘으로 아직 도달할 수 없는 영역이기에 심리 상담 분야에서 AI가 개시된다면 어떤 목적을 위해 활용되는지 살펴보아야 한다. 겉잡을 수 없이 커지는 AI와 챗지피티의 영향에 혼란스러운 사회 속에서 AI가 어떻게 우리의 삶에 이득이 될 수 있는지, 활용의 한계와 장단점을 잘 헤아려 봐야 할 것이다.

지난기사

기후 우울증 (Eco-Anxiety): 기후변화와 정신건강

참고문헌

네이버 지식백과. 챗GPT. 시사상식사전. https://terms.naver.com/entry.naver?docId=6646863&cid=43667&categoryId=43667

안명숙. (2018). 인공지능(AI) 심리상담에 관한 소셜 미디어 빅데이터 분석. 기초학문자료센터. https://www.krm.or.kr/krmts/link.html?dbGubun=SD&m201_id=10083312&res=y

정인선. (2023). 수억대 파격 연봉 제시...'프롬프터 엔지니어' 뭐길래. 한겨레. https://www.hani.co.kr/arti/economy/it/1084265.html

Broderick, R. (2023년 1월 21일). People are using AI for therapy, whether the tech is ready for it or not. Fast Company.

Ingram, D. (2023년 1월 14일). A mental health tech company ran an AI experiment on real users. Nothing’s stopping apps from conducting more. NBC news.

Kumar, H., Musabirov, I., Shi, J., Lauzon, A., Choy, K. K., Gross, O., ... & Williams, J. J. (2022). Exploring The Design of Prompts For Applying GPT-3 based Chatbots: A Mental Wellbeing Case Study on Mechanical Turk. .https://doi.org/10.48550/arXiv.2209.11344

Rowe. (2023년 3월 8일). Music, the Mind, and Artificial Intelligence. 뉴욕대학교.

Sabry Abdel-Messih, M., & Kamel Boulos, M. N. (2023). ChatGPT in Clinical Toxicology. JMIR Medical Education, 9, e46876.

다른 곳에 퍼가실 때는 아래 고유 링크 주소를 출처로 사용해주세요.

http://www.psytimes.co.kr/news/view.php?idx=5980

http://www.psytimes.co.kr/news/view.php?idx=5980

sp5562@nyu.edu